12月19-21日,在哥伦比亚波哥大举行的国际学术会议International Conference on Virtual Reality and Visualization (ICVRV 2025,CCF C类) 上,课题组最新研究成果CO-YOLO: Collaborative Enhancement Network for Efficient Low-Altitude Object Detection被该会议接收并以海报形式进行了展出。

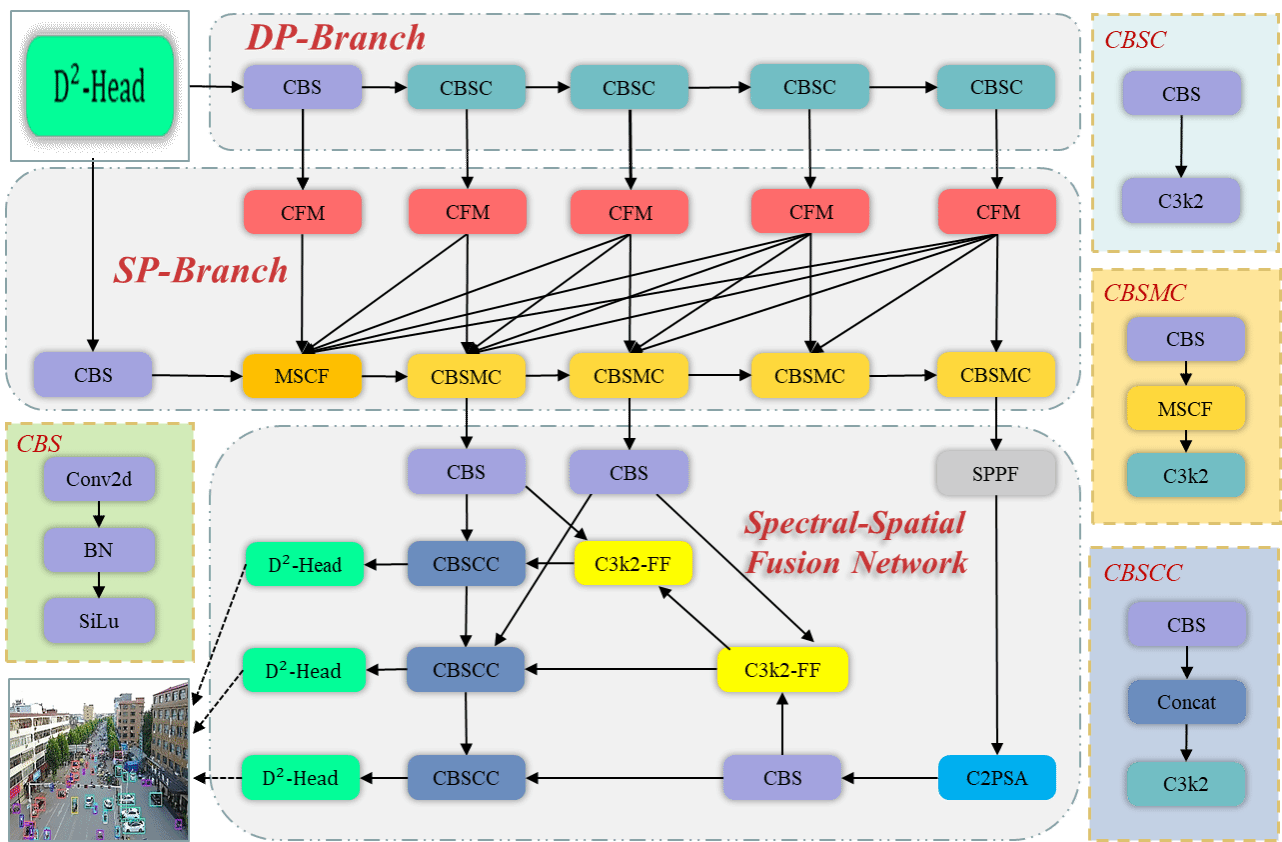

随着无人机技术的飞速发展,低空物体探测已成为计算机视觉领域的研究重点,在智能交通、灾害响应和城市安全方面具有关键应用。然而,由于无人机捕获的图像中存在目标密集、物体遮挡、成像模糊和剧烈的尺度变化等问题,传统的物体检测算法往往无法确保检测准确性。 为了应对这些挑战,我们提出了一种新颖的对象检测框架,该框架创新地结合了双分支协作网络 (DBCN) 作为骨干架构。该模型利用细节分支和语义分支之间的协同作用,有效地利用了低级细节和高级语义的信息,实现了多尺度特征的深度融合。随后,在颈部引入了光谱-空间融合网络 (SSFN),建立了光谱域和空间域之间的协作机制,以有效集成多分辨率特征。此外,我们提出了一种基于DCNv3 的动态可变形头 (D⟡-head),它采用多组动态采样和任务驱动的调制策略,以提高对目标变形、旋转和部分遮挡的鲁棒性。CARPK、Widerperson和Visdrone数据集的广泛实验证明了我们方法的优越性,分别取得了 99.4%、78.8% 和 36.2% 的 MAP50 ,显著优于基线模型 YOLO11 和几种最先进的方法。结果验证了我们的方法在复杂的低空场景中的高精度和稳健性,为低空物体检测提供了有效的解决方案。

coyolo网络结构

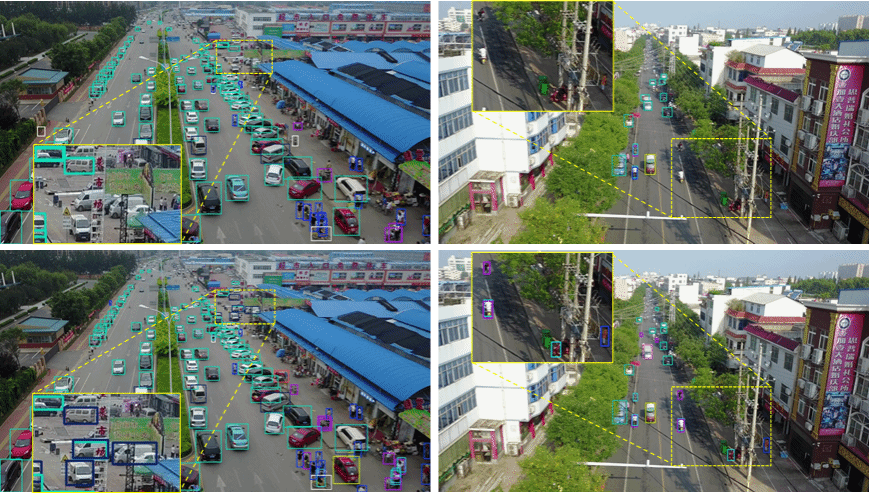

coyolo与yolo11检测效果对比

论文第一作者为2023级硕士生赵宇晗,通讯作者为武相军教授。

该届会议由IEEE和Connected Universal Experiences Labs联合主办。作为中国计算机学会(CCF)推荐的计算机图形学与多媒体领域C类学术会议,ICVRV 2025汇聚全球行业专家、科研学者与产业代表,共探虚拟现实(VR)、增强现实(AR)、混合现实(MR)及可视化技术的前沿趋势与应用落地。